Mehr Autonomie im Wareneingang: Um den neuen Herausforderungen der Branche zu begegnen, sollten Automobilbauer verstärkt in die Modernisierung ihrer Produktionsprozesse investieren. Durch den Einsatz des 3D-Vision-Sensors Visionary-T von SICK in Synergie mit den smarten Algorithmen von Neadvance hat ein großer Automobilbauer in der Tschechischen Republik die Investitionen in seine Logistikstrukturen bereits erhöht und stärkt damit die Zukunftsfestigkeit seines Wareneingangs. Mit vereinten Kräften realisierten die beiden Unternehmen einen weiteren Automatisierungsschritt im Wareneingang und optimierten so die Prozesseffizienz des Kunden.

Depalettieren: Roboter sehen mit 3D-Snapshot-Technologie einfach mehr

Wareneingang als Teil des Gesamtsystems

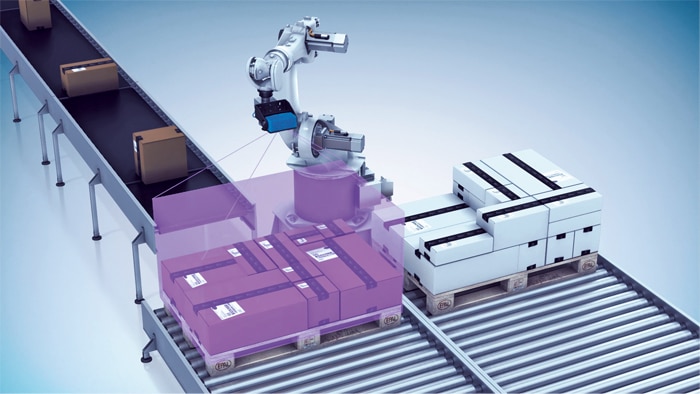

Zentrales Element der Lösung ist ein Knickarmroboter, der mit dem 3D-Vision-Sensor Visionary-T ausgestattet ist. Die Aufgabe des Roboters besteht darin, auf Paletten angelieferte Ware zu entnehmen und auf ein Förderband zu übergeben, das wiederum die Verbindung zum Intralogistiklager herstellt. Schrauben, Spiegel, Armaturenelemente: Vor der Einführung des automatischen Wareneingangssystems wurden die Bauteile nach dem Entladen aus den Lastwagen händisch von der Palette genommen und auf ihren Weg in die Kfz-Produktion geschickt. Heute ist bei dem OEM eine Logistiklösung im Einsatz, die Wareneingang, Hochregallager und Produktion ganzheitlich zusammenführt.

Dafür war es notwendig, den Depalettierroboter so autonom zu machen, dass er die Position der einzelnen Pakete auf einer angelieferten Palette selbstständig und bei jeder Verpackungseinheit immer wieder neu erkennt und so sicher greifen kann. Gelöst wurde diese anspruchsvolle Aufgabe mit einem 3D-Vision-Produkt von SICK: Die Streaming-Kamera Visionary-T CX versorgt die Robotersteuerung dank 3D-Snapshot-Technologie mit dreidimensionalen Bildern.

Lichtlaufzeitmessung zur Bestimmung von Form und Abstand

Zur Erzeugung dieser dreidimensionalen Aufnahmen nutzt das Gerät die 3D-Time-of-Flight-Technologie. Die Technologie basiert auf dem Prinzip der Lichtlaufzeitmessung: Eine integrierte Lichtquelle sendet Licht aus, das anschließend von der Oberfläche eines Objektes zurück an die Kamera reflektiert wird. Die kleinen Zeitunterschiede bis zur Rückkehr des ausgesandten Lichts dienen dazu, die Distanz zur reflektierenden Fläche zu berechnen. Mithilfe spezieller Algorithmen werden die erhobenen Daten dann in eine dreidimensionale Darstellung umgewandelt. Dank der hohen Bildwiederholrate der Kamera kann dieser Vorgang bis zu 50 Mal pro Sekunde erfolgen. Aufgrund der leistungsstarken integrierten aktiven Umgebungsbeleuchtung ist die Kamera selbst bei vollständiger Dunkelheit einsetzbar und erkennt auch Objekte mit sehr geringen Reflexionseigenschaften.

Im Wareneingangssystem des OEM ist Visionary-T CX am Arm des Roboters platziert und fährt als wachsames Auge stetig mit. Daher kann die Streaming-Kamera den dynamischen Beschleunigungen, Reversierbewegungen und Vibrationen des Roboters unmittelbar folgen und konkrete Informationen liefern. Die 3D-Snapshot-Technologie war bei dieser Anwendung für Neadvance ausgesprochen wichtig, da sie in der Lage ist, Tiefen- und Intensitätsinformationen für jedes einzelne Pixel einer Aufnahme gleichzeitig zu erfassen. Und weil Visionary-T keine beweglichen Bauteile benötigt, um Tiefeninformationen zu erheben, ist die Kamera außerdem besonders robust gegen externe Vibrationen und Stöße. Diese Eigenschaft ist gerade dann wichtig, wenn – wie in einem typischen Wareneingang – die automatische Entnahme der angelieferten Waren schnell erfolgen muss.

Im Einsatz liefert Visionary-T CX dann die genannten 3D-Punktwolken, die mit Hilfe passender, von Neadvance entwickelter Algorithmen – basierend auf 3D-Formanalysen – zur Lagebestimmung von Kisten und Kartons genutzt werden. Die damit verbundenen Koordinaten fährt der Roboter dann mit seiner speziellen Greifvorrichtung an, nimmt die Ware verlässlich auf und legt sie auf dem Förderband ab. Für das Greifen der nächsten Kiste startet der Ablauf von vorn. Der Roboter fährt über die Palette, Visionary-T CX macht die benötigten Aufnahmen und liefert die 3D-Daten, die eine Steuereinheit dann für die nächsten Zielkoordinaten verarbeitet.

Gemeinsames Engineering schafft Erfolg

Vor der Einführung der erfolgreichen SICK-Lösung gab es bereits erste eigene Ansätze des OEM für eine autonom arbeitende Roboterstation in seinem Wareneingang. Diese Ansätze basierten jedoch größtenteils auf der Nutzung von 2D-Daten und brachten nicht den gewünschten Erfolg. Der Wechsel zur 3D-Snapshot-Technologie von SICK und die enge Zusammenarbeit mit Neadvance während des Engineeringprozesses führten dagegen zu einem echten technologischen Durchbruch. Ein wesentliches Ziel dieser Kollaboration bestand darin, die Prozesse möglichst reibungslos und stabil zu gestalten – ein Aspekt, der besonders wichtig ist, wenn schwierig zu transportierende Güter anspruchsvolle Greifprozesse für den Roboter nach sich ziehen. Daher konzentrierte sich das Projektteam bei der Entwicklung darauf, vor allem die komplexeren Greifprozesse weiter zu verfeinern. Die 3D-Daten und entsprechenden Punktwolken bieten sehr gute Möglichkeiten, Szenen genauer zu erfassen und auch noch während des laufenden Projekts Anpassungen vorzunehmen. Aufgrund von Einflussfaktoren, deren Tragweite erst bei der Inbetriebnahme vor Ort erkennbar sein würde, war diese Flexibilität eine weitere Entwicklungsanforderung.

Mehr Autonomie für den Roboter

Die neue Lösung arbeitet so verlässlich, präzise und effizient, dass der OEM plant, sie auch in anderen Werken einzusetzen. Der Generalunternehmer und der Systemintegrator, die mit dem Projekt betraut waren, zeigten sich ebenfalls so beeindruckt von der 3D-Snapshot-Technologie und dem Time-of-Flight-Prinzip von Visionary-T CX, dass sie die Lösung standardmäßig in Depalettierungsprozesse integrieren wollen.

Weitere Beiträge:

Automatisierter Wareneingang dank Middleware und vertikaler Integration

Die besten Methoden, um Vision-Sensoren zur Palettierung einzusetzen

Greifbarer Erfolg ist ein großes Puzzle - Perfektes Zusammenspiel bei Robot Vision

Zusammenarbeit auf Augenhöhe

Egal ob Robot Vision, Safe Robotics, End-of-Arm Tooling oder Position Feedback - SICK-Sensoren befähigen den Roboter zu präziserer Wahrnehmung.

Erfahren Sie mehr